![]() 关注我们,学习更多隐私合规讯息

关注我们,学习更多隐私合规讯息![]()

随着世界各国致力于制定人工智能法规,组织很快将面临一波新的人工智能治理规则浪潮。

但是,监管机构今天的期望是什么?

大多数国家尚未制定综合或专门的人工智能法律。中国是一个巨大的例外,其《生成人工智能服务管理暂行办法》于 8 月 15 日生效。但即便如此,它们也被宣传为临时措施。

作为 C-27 法案的一部分,加拿大的《人工智能和数据法案》正在取得进展,但大多数实际细节尚未在两年的时间内制定和实施,这意味着全面了解该法律的要求仍然是一个方法——离开。

欧盟人工智能法案在其文本中阐明了更多细节,正在进行的三场谈判可能会在今年年底结束。尽管如此,该规则手册可能会包括大多数公司义务的两年实施期。

在美国,我们有国家标准与技术研究所人工智能风险管理框架,这是一个自愿框架,旨在指导组织可信地设计、开发、使用和评估人工智能产品,以及白宫人工智能法案蓝图权利,它让我们一睹拜登政府的目标和期望,但没有看到监管机构可以执行的硬性要求。

那么,在此期间我们会处于什么位置呢?

美国联邦贸易委员会回答了这个问题,全球越来越多的监管机构也回答了这个问题。

FTC 专员阿尔瓦罗·贝多亚 (Alvaro Bedoya) 在 4 月份举行的 2023 年 IAPP 全球隐私峰会上的主题演讲中明确表示。

“首先,生成式人工智能受到监管,”

“第二,该法律的大部分内容侧重于对普通人的影响。而不是专家,而是普通人。

第三,该法律的一些内容需要解释。‘不可预测性’很少成为辩护理由。第四,展望未来,监管机构和整个社会将需要公司做更多的事情来保持透明和负责任。”

此后不久,联邦贸易委员会主席莉娜·汗在她的《纽约时报》专栏文章中重申了他的信息。

随着世界各地的监管机构根据现有法律和相关领域对人工智能系统展开调查并为组织发布指南,他们的问题、声明和行动让我们深入了解监管机构的期望。虽然他们的大部分想法尚未在法庭上得到检验,但这些调查让人们了解了监管机构的关注重点以及组织应该问自己的问题。

到硬性法律颁布时,组织将投入数千亿美元用于人工智能系统的开发和集成。考虑到监管机构的问题,构建这些系统并投资人工智能治理结构是非常值得的。

在某些情况下,可接受的甚至可行的答案尚不清楚。技术和治理结构正在迅速发展。了解所提出的问题并制定允许您的组织做出响应的人工智能治理计划是关键的一步。当面临执法行动时,重建或推迟算法的成本将要高得多。

但,监管机构今天在问什么?

组织应该准备回答哪些问题??

以下长篇警告

风险评估和缓解

❇️监管机构的问题集中在人工智能在一系列领域带来的风险以及公司为解决这些风险而采取的措施。因此,有关风险评估的问题是一个重要特征。这些可能包括:

您进行过人工智能影响评估吗?

你们有哪些政策、程序和人员来评估人工智能风险和安全?

谁参与评估人工智能风险以及产品发布时这些风险是否已得到充分缓解?这些人的角色、报告结构、头衔、部门和相关专业知识是什么?

❇️联邦贸易委员会以及许多其他机构就这方面的人员配置提出了广泛的问题,例如:

您考虑了哪些风险?

您实施了哪些风险缓解措施?

您使用什么方法来训练或重新训练模型?

注:较长内容可滚动查看

透明度和可解释性

欧盟、英国和美国监管机构要求人工智能系统数据处理的透明度,以及有关系统如何工作的易于理解的解释。英国信息专员办公室询问“你们将如何确保透明度”。正如其他监管机构的沟通所表明的那样,该问题包含许多子问题,包括:

有关您的数据处理活动(包括处理逻辑)的信息在哪里?它是否公开且易于获取?

您的数据处理信息如何传达给个人?

有关数据主体权利的信息在哪里公开传达?

意大利数据保护机构 Garante 更进一步,呼吁“通过广播、电视、报纸和互联网”开展提高认识活动,“告知个人如何使用其个人数据来训练算法”。联邦贸易委员会还走得更远,要求提供测试和文件来证实主张,并建议组织应该考虑从一开始就将其纳入其中。

您是否进行过或依赖于测试或研究来评估个人对您的人工智能系统的方法、准确性、数据保留和使用以及您所披露的信息的理解?

采购数据

❇️监管机构正在询问个人如何与构建和部署人工智能产品的公司合作。他们的许多早期问题都集中在个人如何行使自己的隐私权。

您制定了哪些政策和程序来回应有关个人数据处理或基于人工智能生成准确或不准确个人信息的个人投诉?

您收到了多少关于基于人工智能生成有关特定个人的虚假、误导或诽谤信息的投诉?

哪些个人或角色负责制定、实施和监督与个人投诉处理相关的政策?

您为个人提供哪些机制来选择不收集、保留、使用、分析或传输其个人信息?

您向个人提供哪些工具,使他们能够访问、纠正或删除用于训练人工智能模型或作为人工智能产品输出生成的个人数据?

❇️在关于人工智能中个人数据使用的咨询指南中,新加坡个人数据保护委员会建议在披露中解决上述问题,以加深对训练数据集质量以及提高模型准确性和性能所采取步骤的理解。披露还应回答以下问题:

您的源数据是否包含受版权保护的信息?

您的源数据是否包含个人信息?

以下部分涵盖了有关答案可能引发的与隐私、偏见、知识产权保护和其他问题相关的风险的相关问题。

个人要求

注:较长内容可滚动查看

Garante 在其通讯中承认了这一领域的技术挑战以及“协调技术进步与尊重个人权利”所采取的步骤,并表示希望继续努力。

监管机构正在询问超出隐私范围的个人请求和担忧,包括以下问题:

您收到了多少针对系统卡中确定的特定风险和安全问题的投诉?

自动决策、歧视和公民权利

第三方管理和责任

法国 DPA(国家信息与自由委员会)很快将发布关于“组成数据库的实体、从数据中制定模型的实体以及使用这些模型的实体之间分担责任”的建议。

*文章来源:iapp.org

*原标题:Regulators' rulebook for AI: Bit by bit

*整理编辑:A隐小私(yinxiaosi00)

往/期/回/顾

合规官与律师:有何区别?

快报!2023年隐私合规薪资调查报告新鲜出炉!隐私工作者平均基本工资增长10%!

CIPPE+CIPM双证到手!他如何在3个月内完美通过的?

什么是合规性?不同的合规岗位的职责是什么?

GDPR(通用数据保护条例)存在的意义及对公司的作用

■ DEPTH

想了解IAPP哪个证书适合你?

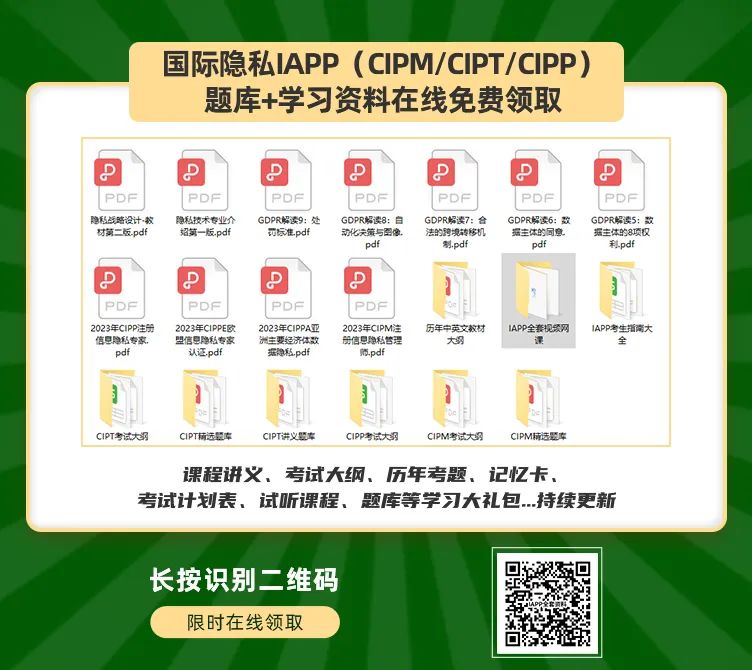

全套资料长按扫码领取

全套资料试听课在线试讲

-End-

■ DEPTH

想知道IAPP哪个证书适合你吗?

资格评价可直接扫描码

免费评价/赠送一份国际隐私认证学习资料一份

感觉不错你就赞赞我吧!

点分享

点点赞

点在看

戳这个,领取IAPP备考资料包